Ostatnio zauważyłem, że ChatGPT zaczął generować absurdalnie długie zapytania wyszukiwania.

Niezależnie od tego, czy to zachowanie będzie się utrzymywać, to zdecydowanie jest to trend. Modele LLM wyszukują bardzo konkretne zapytania, które z reguły są bardzo długie.

Ale to nie wszystko. Frazy kluczowe na długi ogon dalej prezentują możliwości organicznego wzrostu. I chociaż nie generują zbyt wiele podsumowań AI, to częściej skutkują kliknięciem, ponieważ intencja jest bardziej sprecyzowana.

Świadomi użytkownicy szukają konkretnego rozwiązania, więc są bardziej skłonni do kliknięcia i konwersji, jeśli znajdą to, czego szukają. Więcej na ten temat przeczytasz w artykule poświęconym rodzajom i zachowaniom użytkowników.

Dlaczego ChatGPT generuje „absurdalnie” długie zapytania?

Kiedy ChatGPT (lub inny model z dostępem do sieci) decyduje się na wyszukanie informacji, nie działa jak człowiek w 2010 roku, który wpisywał w Google „buty bieganie cena”. Działa jak badacz.

Oto główne powody generowania tak długich i specyficznych zapytań:

1. Maksymalizacja precyzji semantycznej (Semantic Precision)

Modele językowe (LLM) „rozumują” na podstawie kontekstu, a nie dopasowania znaków. Krótkie frazy są wieloznaczne.

- Przykład: Fraza „Zamek” może dotyczyć budowli lub suwaka.

- LLM: Woli zapytać: „Historia budowy Zamku Królewskiego w Warszawie w kontekście zniszczeń wojennych”, aby wyeliminować szum informacyjny i otrzymać wyniki idealnie dopasowane do intencji użytkownika.

2. Symulacja ludzkiej konwersacji (Natural Language Processing)

Modele są trenowane na ogromnych zbiorach danych konwersacyjnych. Dla AI naturalnym sposobem zadawania pytania jest pełne zdanie. Wyszukiwarki (Google, Bing) również ewoluowały, aby lepiej rozumieć język naturalny (dzięki algorytmom takim jak BERT czy MUM), więc AI „wie”, że może pytać wyszukiwarkę tak, jakby pytało człowieka.

3. Agentyczność i dekompozycja problemu

Kiedy zadajesz AI złożone pytanie, model często rozbija je na podproblemy.

- Użytkownik: „Czy warto inwestować w krypto w 2025?”

- Wyszukiwanie AI: Zamiast wpisać „krypto 2025”, model może wygenerować: „Prognozy analityków finansowych dla Bitcoin i Ethereum na rok 2025 w kontekście regulacji UE”. Długie zapytanie jest próbą „wyciągnięcia” gotowej syntezy, a nie tylko listy linków.

4. Unikanie halucynacji (grounding)

Im bardziej specyficzne zapytanie, tym większa szansa, że zwrócony fragment tekstu (snippet) będzie zawierał dokładną odpowiedź, którą model może zacytować. Krótkie frazy często prowadzą do ogólnych stron głównych, które dla modelu są trudniejsze do szybkiego przetworzenia w poszukiwaniu jednego faktu.

| Model / Narzędzie | Zachowanie |

| Perplexity AI | Jest pionierem tego podejścia. Często bierze krótkie zapytanie użytkownika i na naszych oczach „przepisuje” je na długie, precyzyjne pytanie badawcze, aby przeszukać sieć. |

| Google Gemini | Dzięki głębokiej integracji z ekosystemem Google, Gemini często generuje wieloczłonowe zapytania weryfikujące, zwłaszcza gdy korzystasz z funkcji sprawdzania faktów (double-check). |

| Microsoft Copilot (Bing) | Działa na silniku GPT-4, więc zachowuje się bardzo podobnie do ChatGPT. Często łączy słowa kluczowe z operatorami logicznymi w bardzo długie ciągi, aby zmusić Binga do precyzji. |

| SearchGPT (OpenAI) | Prototyp wyszukiwarki OpenAI opiera się niemal wyłącznie na koncepcji „conversational search”, gdzie długi ogon jest domyślnym trybem interakcji. |

Co to oznacza dla przyszłości SEO i AI SEO (GEO)?

Wchodzimy w erę GEO (Generative Engine Optimization) zgodnie ze zmianą paradygmatu od wyszukania do asystowania.

Koniec „słów kluczowych”, początek „odpowiedzi na pytania”

Tradycyjne SEO polegało na upychaniu słów kluczowych. AI SEO polega na tworzeniu treści, która jest najlepszą odpowiedzią na bardzo specyficzne pytanie. Jeśli ChatGPT generuje zapytanie o długości 15 słów, treść musi dokładnie na te 15 słów odpowiadać, aby zostać zacytowaną jako źródło.

Struktura treści pod AI

LLM-y lubią strukturę. Treści, które wprost odpowiadają na pytania (np. w formie FAQ, jasnych nagłówków, list punktowanych), są łatwiejsze do „zrozumienia” i zacytowania przez AI.

Wzrost znaczenia intencji (Intent Optimization)

Wyszukiwanie przesuwa się z informacyjnego („jaka pogoda”) na doradcze („jaki płaszcz ubrać na deszcz w górach przy 10 stopniach”).

Dlatego efekty pozycjonowania zanotują dostawcy treści, którzy dostarczą precyzyjnych odpowiedzi na najbardziej specyficzne i niszowe zapytania użytkowników:

- Ruch przejmą serwisy, które wyczerpująco opiszą wąskie, specjalistyczne zagadnienia.

- Eksperci, którzy rozwiążą konkretne, nietypowe problemy użytkowników.

- Najwięcej zyskają firmy, które precyzyjnie odpowiedzą na niszowe pytania klientów.

Jak znaleźć frazy na długi ogon z potencjałem?

Narzędzia SEO, takie jak Semrush pozwalaj na filtrowanie słów kluczowych i zapewniają solidny wgląd w dłuższe zapytania. Do tego można filtrować listy słów kluczowych według minimalnej liczby słów w zapytaniach.

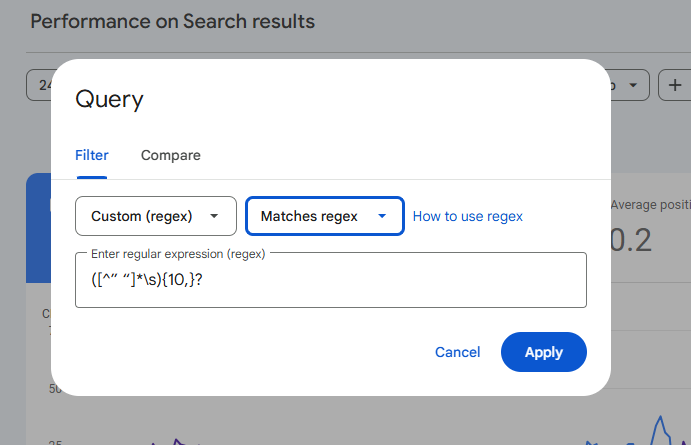

Google Search Console również pozwala na wyświetlenie listy aktualnych fraz. Wystarczy użyć wyrażenia regularnego (regex), aby znaleźć dłuższe zapytania. Przejdź do sekcji „Wydajność”, kliknij „Dodaj filtr”, wybierz „Zapytanie” i opcję „Niestandardowe (wyrażenie regularne)”.

Skorzystaj z tego wzoru:

([^” “]*\s){10,}?

To wyrażenie regularne filtruje zapytania zawierające więcej niż 10 słów. Możesz zmienić „10” na „5” lub „25”, aby znaleźć zapytania zawierające odpowiednio więcej niż 5 lub 25 słów. Z tego artykułu dowiesz się, jak zoptymalizować stronę na długie frazy kluczowe.

Więcej na ten temat przeczytasz w artykule od NectiveDigital.